Stell dir vor, du sitzt in einem Architektur-Meeting für eine große Enterprise-Plattform: Ein B2B-Firmenkundenportal für Flugbuchungen. Mandantenfähigkeit ist Pflicht, hohe Skalierbarkeit, Microservices, Event-Driven Messaging, Kubernetes-Deployment und ein modernes Single-Page-Application (SPA) Frontend. Zwei Senior Architekten kalkulieren den Aufwand auf mehr als ein Jahr Projektzeit, inklusive umfangreichem Team und riesigem Budget.

Bis vor kurzem wäre diese Schätzung absolut realistisch gewesen. Aber die Zeiten haben sich dramatisch geändert. Heute habe ich genau dieses Projekt – auf Basis der ursprünglichen Enterprise-Anforderungen – mit KI-Agenten in etwa 3 Stunden von der Architekturzeichnung bis zum ausführbaren und live bedienbaren Demo-System in der Google Cloud gebaut.

Der Paradigmenwechsel in der Entwicklung

Dieses Projekt illustriert nicht nur die enorme Geschwindigkeit moderner KI-Tools, sondern auch, wie elementar wichtig architektonische Expertise geworden ist. Die KI übernimmt das Tippen, das Bootstrapping und das Verknüpfen von Schnittstellen. Aber die Architektur, die Vorgaben zur Mandantenfähigkeit, Security-Constraints und Datenmodellierung bedürfen nach wie vor der Erfahrung eines Senior Software Architects. Erst diese Kombination liefert Enterprise-Ergebnisse in Rekordzeit.

Die Anforderungen an das B2Bneo Portal

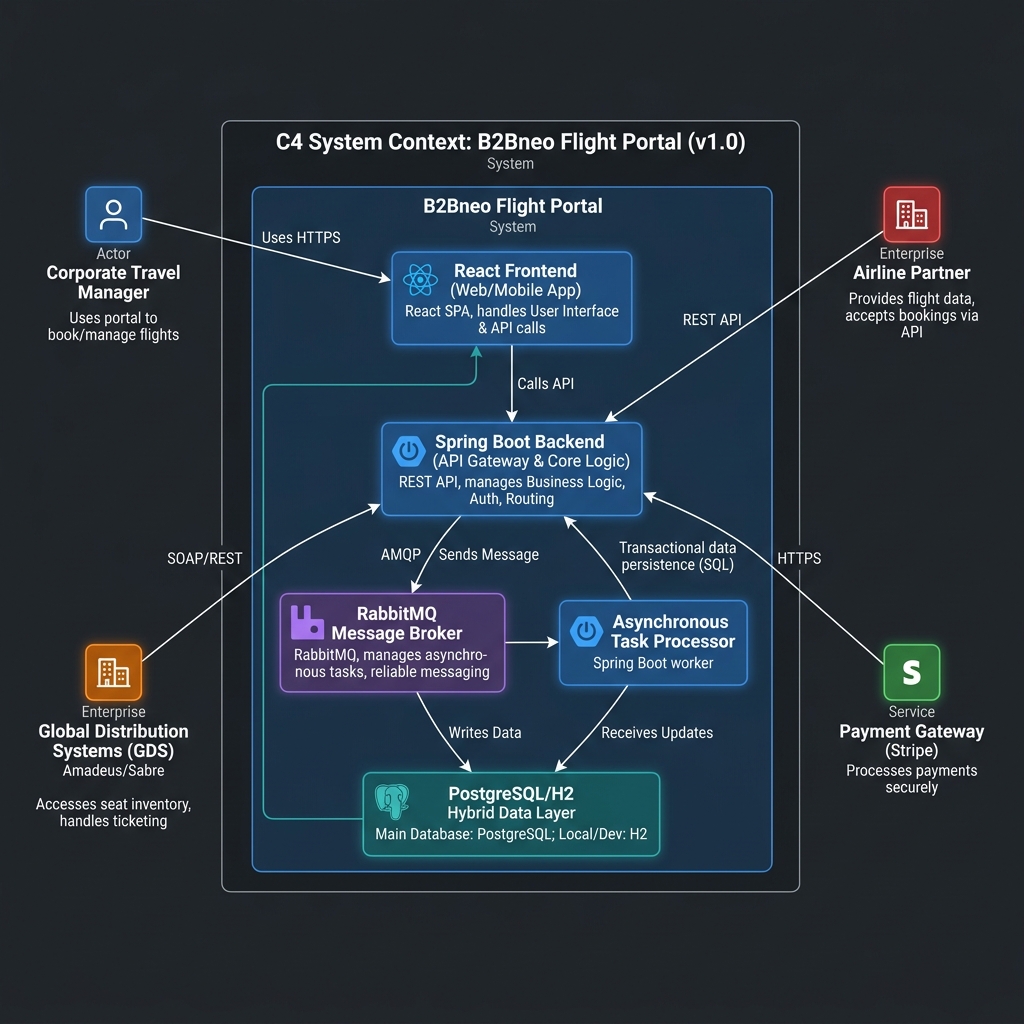

Das Ziel war nicht einfach ein "Todo-Listen"-Klon, sondern ein repräsentativer Proof of Concept (PoC) eines komplexeren Business-Use-Cases mit folgenden Anforderungen:

Mandantenfähigkeit

Isolierte Daten für unterschiedliche Firmenkunden (HTTP-Header `X-Company-Id`).

Flugbuchungsprozess

Filterbare Flugsuche, Erfassung von Reisezweck, Kostenstelle und Passagieren.

Event-Driven Logic

Nutzung von Message-Brokern für asynchrone Weiterleitung von Buchungen.

Skalierbarkeit

Vorbereitet auf Container-Orchestrierung via Kubernetes mit Prometheus-Metriken.

Der Technologie-Stack

Eine kompromisslos moderne und robuste Enterprise-Technologie-Mischung:

Backend

- Java 17

- Spring Boot 3.2

- Spring Data JPA / Hibernate

- OpenAPI 3.0 (Swagger)

Frontend

- React 18

- Vite als Build-Tool

- Axios für REST-Calls

Infrastruktur & Messaging

- RabbitMQ (AMQP)

- PostgreSQL 15

- Docker & Docker Compose

- Kubernetes (AKS Vorbereitung)

Monitoring & CI/CD

- Micrometer + Prometheus

- Jenkins Pipeline

- JUnit 5 + Mockito

1 Jahr vs. 3 Stunden

Warum hat dieses Projekt früher so lange gedauert und warum geht das heute so unfassbar schnell?

Monatelange UML-Diagramm-Phasen, wochenlanges Boilerplate-Coding, aufreibende Abstimmungsrunden zwischen Frontend- und Backend-Entwicklern, endlose Infrastruktur-Konfigurations-Probleme. Jede API-Änderung verursachte Breakages, und das CI/CD-Setup nahm Wochen in Anspruch.

Ich präsentiere der KI das relationale Design, die API-Verträge und die Business-Logik (Kostenstellen, Company-IDs, RabbitMQ Setup). Das LLM generiert den vollständigen Spring Boot Code (inkl. JPA Repositories und sauberen Controllern), schließt das React-Frontend über Axios direkt an und legt eine fertige docker-compose.yml sowie Jenkins-Pipelines obendrauf.

Professioneller Disclaimer: Demo vs. Produktion

Um realistische professionelle Standards zu wahren, muss klar unterschieden werden: Das hier präsentierte System ist eine vollständige Implementierung für eine Demo-Laufzeitumgebung in der Google Cloud. Alle funktionalen Anforderungen (inklusive Microservice-Kommunikation und Mandantenfähigkeit) sind programmatisch umgesetzt und das Portal ist live einsatz- und direkt testfähig.

Es enthält in dieser frühen Phase jedoch noch keine automatisierten Test-Suiten (Unit-, Integrations- oder End-to-End-Tests). Die unerlässliche Enterprise-Härtung (Security Audit, Penetration Testing) muss ebenfalls noch manuell erfolgen, bevor ein solches System in Produktion gehen kann. Ein System dieses Ausmaßes ungetestet in ein echtes Kunden-Produktivsystem (Live-Traffic) zu überführen, wäre fahrlässig. Der entscheidende Punkt ist jedoch: Das architektonische Fundament und die gesamte Business-Logik stehen. Man kann es dem Kunden bereits heute als Proof of Concept (PoC) vorführen. Die Time-to-Market für einen solch komplexen Prototypen hat sich de facto von vielen Monaten auf einen Nachmittag reduziert.

Mein Systemischer Ansatz

Gute Software entsteht nicht durch blindes Codegenerieren. Es ist das Wissen um die Fallstricke in verteilten Systemen – wie RabbitMQ Acknowledgements sicherzustellen sind, wie Transaktionen im Backend sauber abgerollt werden und warum das JWT-Token-Design für B2B-Mandanten zentral ist. Die KI ist mein perfektes Werkzeug, das auslösend wirkende Entwicklungs-Nadelöhr – aber das Rad bleibt im festen Griff der Erfahrung.

Deep Dive: Die Google Cloud Architektur

Ein wesentliches Merkmal echter Enterprise-Lösungen ist das saubere Deployment in einer Cloud-nativen Infrastruktur. Für dieses Showcase wurde Google Cloud Run gewählt. Warum? Weil es Serverless Container Orchestration bietet: Die Anwendung skaliert nach Traffic auf Null herunter (um Kosten im Leerlauf zu sparen) und bootet bei Anfrage innerhalb von Sekunden wieder hoch.

1. Der Backend Container (Enterprise Core)

Die Architektur ist originär auf eine hochskalierbare PostgreSQL-Datenbank und asynchrones Event-Messaging via RabbitMQ ausgelegt (z. B. für das asynchrone Weiterleiten eines BookingCreatedEvent an Invoice-Services). Das Spring Boot 3 Backend wurde dazu als Fat-JAR in ein leichtgewichtiges Docker Multi-Stage Image verpackt.

Für das aktuell erreichbare, hochgradig portable Google-Cloud-Setup haben wir uns aus Effizienzgründen jedoch für ein bewährtes Demo-Fallback auf eine H2 In-Memory Datenbank entschieden. Um die Präsentationsfähigkeit sicherzustellen, injiziert ein programmatischer Spring-Mechanismus (ResourceDatabasePopulator) bei jedem Container-Kaltstart zuverlässig über 100 dynamisierte Flugrouten aus einer .sql-Definitionsdatei. Dieser architektonische Kniff ermöglicht voll-performantes Filtering nach Mandanten-ID ohne auf externe Datenbank-Instanzen warten zu müssen.

2. Der Frontend Container (React + Nginx)

Das Frontend ist eine moderne, hoch-performante React 18 SPA (Single Page Application). Das Projekt nutzt Vite als zeitgemäßen und extrem schnellen Build-Bundler. Für die synchrone Kommunikation mit der Backend-REST-Schnittstelle sorgt die Bibliothek Axios. Die grafische Oberfläche (UI) wurde mithilfe von stark optimiertem CSS (angelehnt an Tailwind-Prinzipien) implementiert, um ein interaktives, responsives Dashboard zu realisieren. Nach dem automatisierten Production-Build wird diese statische App in einen dedizierten NGINX Alpine Docker Container verpackt. Der NGINX fungiert als blitzschneller Proxy und Auslieferungsserver in der Cloud-Umgebung, der

Ablaufdiagramm: Container Orchestrierung in Google Cloud

Benutzer (Browser)

Portal-Aufruf über sicheres HTTPS

Frontend Container (Google Cloud Run)

NGINX Alpine Webserver liefert die kompilierte React 18 / Vite SPA aus. JS führt dynamisches Clientseitiges Routing durch.

Backend Container (Google Cloud Run)

Java 21, Spring Boot 3 Controller. Verifiziert Requests (CORS, Company-IDs) und orchestriert die Business-Logik.

PostgreSQL / H2 DB

Persistenz & programmatische Bootstrap-Initialisierung der Demo-Flüge (+100 Datensätze).

RabbitMQ Broker

Asynchrones Event-Routing (z.B.

BookingCreated) für Microservice Subscriber.

Interoperabilität & Open Source Stack

Ein weiterer kritischer Baustein für jedes professionelle Microservice-Backend ist seine sofortige Dokumentation und Testbarkeit durch Drittsysteme. Hier kommt Swagger (OpenAPI 3.0) zum Einsatz. Die springdoc-openapi Bibliothek injiziert sich nahtlos in den Backend-Container. Über einen speziellen Endpunkt (/swagger-ui/index.html) steht der Live-Instanz augenblicklich eine dynamische, visuell ansprechende HTTP-Spezifikation zur Verfügung.

Stakeholder, externe Dienstleister und andere Entwickler können darüber die dokumentierten API-Verträge nicht nur einsehen, sondern HTTP-Calls (GET, POST etc. inklusive Mock-Header wie X-Company-Id) direkt interaktiv und isoliert in der Cloud testen, ohne eine einzige Zeile Code bzw. ein eigenes Skript schreiben zu müssen.

Zusammenfassung der Core Open-Source-Tools:

- Java 21 & Spring Boot 3: Die Industriestandards für robuste Backends. Für die Datenpersistenzschicht kommt Spring Data JPA mit Hibernate zum Einsatz.

- RabbitMQ & PostgreSQL 15: Das Enterprise-Datenfundament. Postgres garantiert ACID-Transaktionen, während RabbitMQ das zuverlässige Entkoppeln (Asynchronität) der Microservices über Event-Broadcasting stemmt.

- React 18 & Vite: Für eine hochmoderne, deklarative Frontend-Architektur.

- Docker (Multi-Stage Builds): Vollständige Containerisierung. Build-Stages dicken Container radikal ab, sodass keine Kompilierungswerkzeuge in den produktiven Deployments (Cloud Run) landen.

- Axios: Ein verlässlicher HTTP-Client für die Client-seitigen REST-Verbindungen.

- Swagger UI (OpenAPI 3): Automatisch generierte und visuell testbare Dokumentation der Endpunkte.